Untuk BMS, BUS, Industri, Kabel Instrumentasi.

Elon Musk dan tim xAI secara resmi meluncurkan versi terbaru Grok, Grok3, selama siaran langsung. Sebelum acara ini, sejumlah besar informasi terkait, ditambah dengan promosi Musk yang gencar 24/7, telah meningkatkan ekspektasi global terhadap Grok3 ke tingkat yang belum pernah terjadi sebelumnya. Seminggu yang lalu, Musk dengan percaya diri menyatakan selama siaran langsung saat mengomentari DeepSeek R1, "xAI akan meluncurkan model AI yang lebih baik." Dari data yang disajikan secara langsung, Grok3 dilaporkan telah melampaui semua model arus utama saat ini dalam tolok ukur untuk matematika, sains, dan pemrograman, dengan Musk bahkan mengklaim bahwa Grok3 akan digunakan untuk tugas komputasi yang terkait dengan misi Mars SpaceX, dengan memprediksi "terobosan pada tingkat Hadiah Nobel dalam waktu tiga tahun." Namun, ini saat ini hanya pernyataan Musk. Setelah peluncuran, saya menguji versi beta terbaru Grok3 dan mengajukan pertanyaan jebakan klasik untuk model besar: "Mana yang lebih besar, 9.11 atau 9.9?" Sayangnya, tanpa kualifikasi atau tanda apa pun, Grok3 yang katanya paling pintar itu tetap tidak dapat menjawab pertanyaan ini dengan benar. Grok3 gagal mengidentifikasi makna pertanyaan itu secara akurat.

Tes ini dengan cepat menarik perhatian banyak teman, dan secara kebetulan, berbagai tes serupa di luar negeri telah menunjukkan Grok3 kesulitan dengan pertanyaan fisika/matematika dasar seperti "Bola mana yang jatuh lebih dulu dari Menara Pisa?" Oleh karena itu, ia secara jenaka dicap sebagai "seorang jenius yang tidak mau menjawab pertanyaan sederhana."

Grok3 bagus, tetapi tidak lebih baik dari R1 atau o1-Pro.

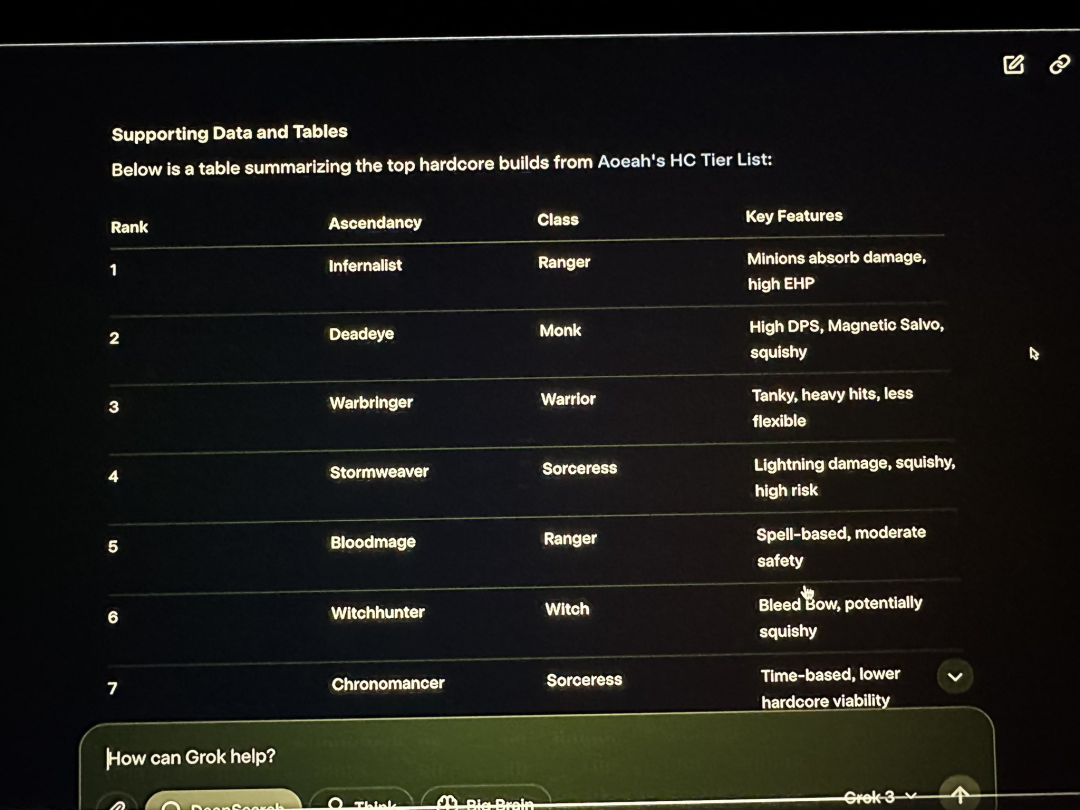

Grok3 mengalami "kegagalan" pada banyak uji pengetahuan umum dalam praktiknya. Selama acara peluncuran xAI, Musk mendemonstrasikan penggunaan Grok3 untuk menganalisis kelas karakter dan efek dari gim Path of Exile 2, yang ia akui sering ia mainkan, tetapi sebagian besar jawaban yang diberikan oleh Grok3 tidak benar. Musk selama siaran langsung tidak menyadari masalah yang jelas ini.

Kesalahan ini tidak hanya memberikan bukti lebih lanjut bagi netizen luar negeri untuk mengejek Musk karena "menemukan pengganti" dalam permainan tetapi juga menimbulkan kekhawatiran signifikan mengenai keandalan Grok3 dalam aplikasi praktis. Untuk "jenius" seperti itu, terlepas dari kemampuan aktualnya, keandalannya dalam skenario aplikasi yang sangat kompleks, seperti tugas eksplorasi Mars, masih diragukan.

Saat ini, banyak penguji yang menerima akses ke Grok3 beberapa minggu lalu, dan mereka yang baru menguji kemampuan model tersebut selama beberapa jam kemarin, semuanya mengarah pada kesimpulan umum: "Grok3 bagus, tetapi tidak lebih baik dari R1 atau o1-Pro."

Pandangan Kritis tentang "Disrupting Nvidia"

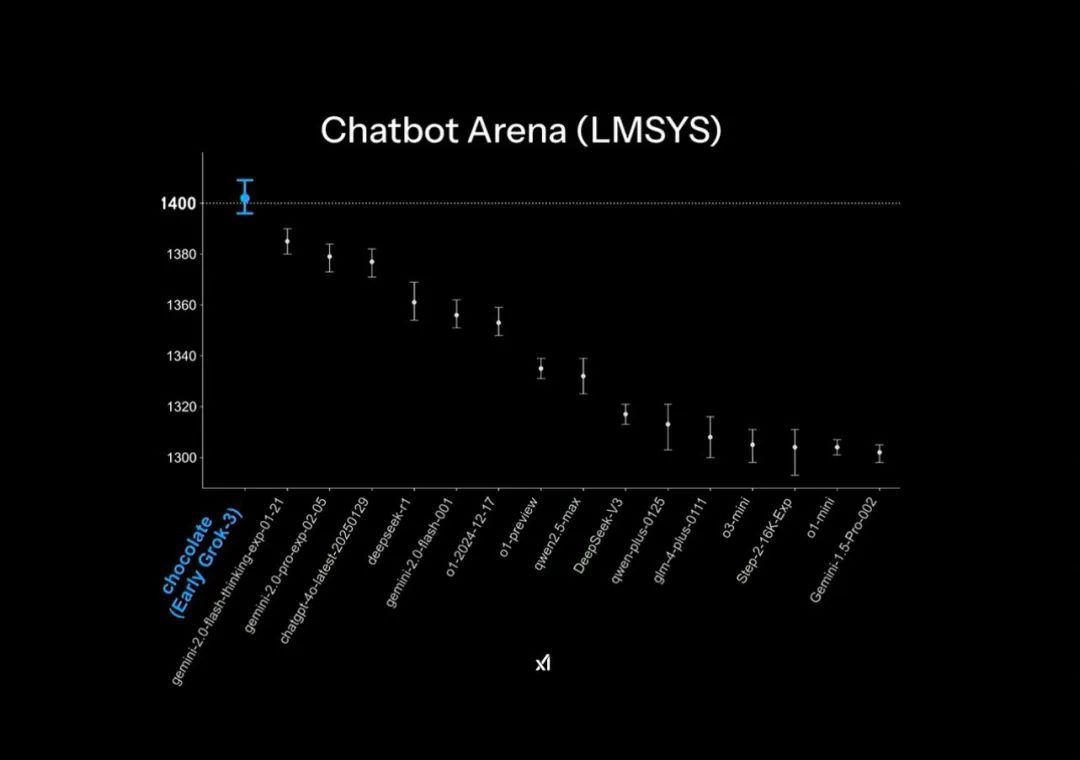

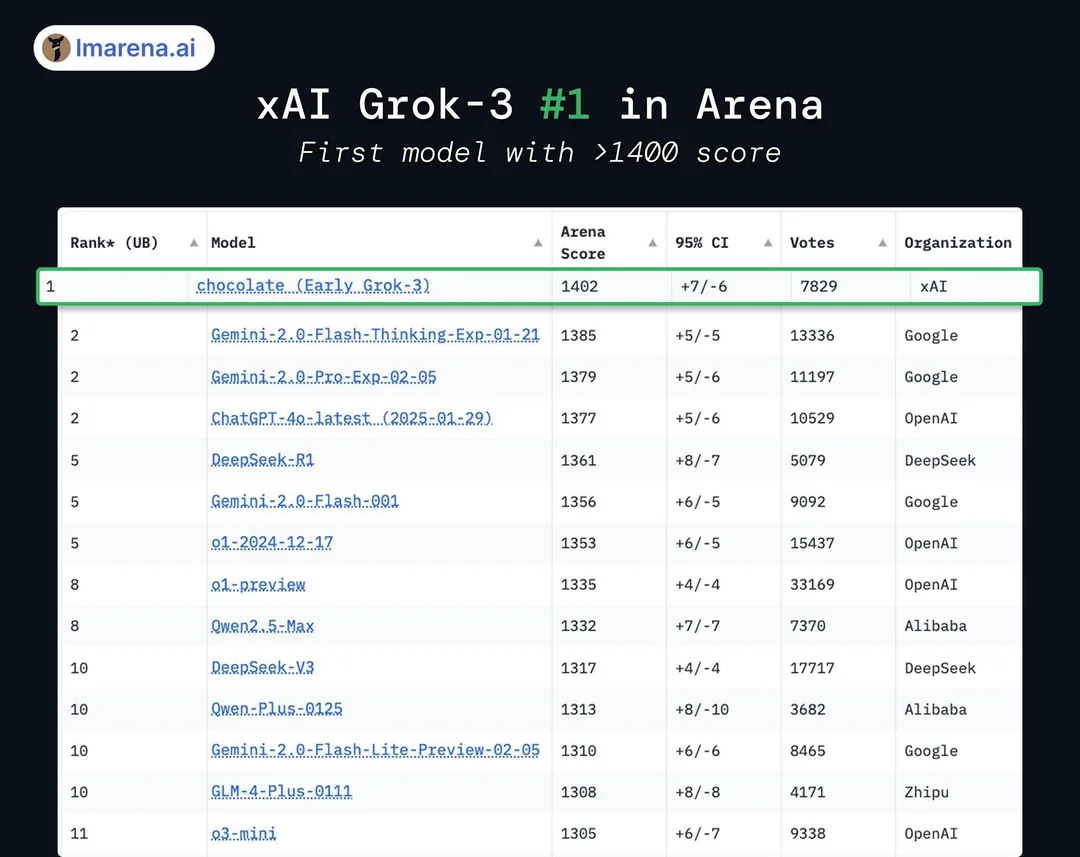

Dalam PPT yang disajikan secara resmi selama rilis, Grok3 ditunjukkan "jauh di depan" di Chatbot Arena, tetapi ini dengan cerdik menggunakan teknik grafis: sumbu vertikal pada papan peringkat hanya mencantumkan hasil dalam rentang skor 1400-1300, membuat perbedaan 1% asli dalam hasil pengujian tampak sangat signifikan dalam presentasi ini.

Dalam hasil penilaian model aktual, Grok3 hanya unggul 1-2% dari DeepSeek R1 dan GPT-4.0, yang sesuai dengan pengalaman banyak pengguna dalam uji praktis yang menemukan "tidak ada perbedaan yang nyata." Grok3 hanya mengungguli para penerusnya sebesar 1%-2%.

Meskipun Grok3 telah memperoleh skor lebih tinggi daripada semua model yang saat ini diuji secara publik, banyak yang tidak menganggapnya serius: lagipula, xAI sebelumnya telah dikritik karena "manipulasi skor" di era Grok2. Karena papan peringkat memberikan hukuman pada gaya panjang jawaban, skornya menurun drastis, yang menyebabkan orang dalam industri sering mengkritik fenomena "skor tinggi tetapi kemampuan rendah."

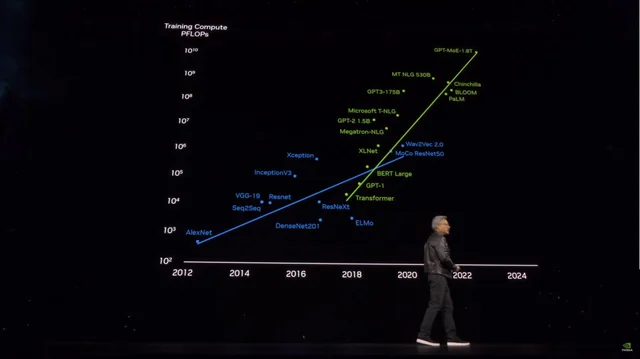

Baik melalui "manipulasi" papan peringkat atau trik desain dalam ilustrasi, mereka mengungkap xAI dan obsesi Musk dengan gagasan "memimpin kelompok" dalam kemampuan model. Musk membayar harga yang mahal untuk margin ini: selama peluncuran, ia membanggakan penggunaan 200.000 GPU H100 (mengklaim "lebih dari 100.000" selama siaran langsung) dan mencapai total waktu pelatihan 200 juta jam. Hal ini membuat beberapa orang percaya bahwa ini merupakan keuntungan signifikan lainnya bagi industri GPU dan menganggap dampak DeepSeek pada sektor tersebut sebagai "bodoh." Khususnya, beberapa orang percaya bahwa kekuatan komputasi semata akan menjadi masa depan pelatihan model.

Namun, beberapa netizen membandingkan konsumsi 2000 GPU H800 selama dua bulan untuk memproduksi DeepSeek V3, dan menghitung bahwa konsumsi daya pelatihan Grok3 yang sebenarnya adalah 263 kali lipat dari V3. Kesenjangan antara DeepSeek V3, yang memperoleh skor 1402 poin, dan Grok3 hanya di bawah 100 poin. Setelah data ini dirilis, banyak yang segera menyadari bahwa di balik gelar Grok3 sebagai "terkuat di dunia" terdapat efek utilitas marjinal yang jelas—logika model yang lebih besar yang menghasilkan kinerja yang lebih kuat telah mulai menunjukkan hasil yang semakin berkurang.

Bahkan dengan "skor tinggi tetapi kemampuan rendah," Grok2 memiliki sejumlah besar data pihak pertama berkualitas tinggi dari platform X (Twitter) untuk mendukung penggunaan. Namun, dalam pelatihan Grok3, xAI secara alami menghadapi "batas" yang saat ini dihadapi OpenAI—kurangnya data pelatihan premium dengan cepat memperlihatkan utilitas marjinal dari kemampuan model tersebut.

Pengembang Grok3 dan Musk kemungkinan besar adalah orang pertama yang memahami dan mengidentifikasi fakta-fakta ini secara mendalam, itulah sebabnya Musk terus-menerus menyebutkan di media sosial bahwa versi yang dialami pengguna saat ini "masih versi beta" dan bahwa "versi lengkapnya akan dirilis dalam beberapa bulan mendatang." Musk telah mengambil peran sebagai manajer produk Grok3, yang menyarankan pengguna memberikan umpan balik tentang berbagai masalah yang ditemukan di bagian komentar. Ia mungkin adalah manajer produk yang paling banyak diikuti di Bumi.

Namun, dalam sehari, kinerja Grok3 tidak diragukan lagi menimbulkan kekhawatiran bagi mereka yang berharap untuk mengandalkan "kekuatan komputasi yang besar" untuk melatih model besar yang lebih kuat: berdasarkan informasi Microsoft yang tersedia untuk umum, GPT-4 OpenAI memiliki ukuran parameter sebesar 1,8 triliun parameter, lebih dari sepuluh kali lipat dari GPT-3. Rumor menunjukkan bahwa ukuran parameter GPT-4.5 mungkin lebih besar lagi.

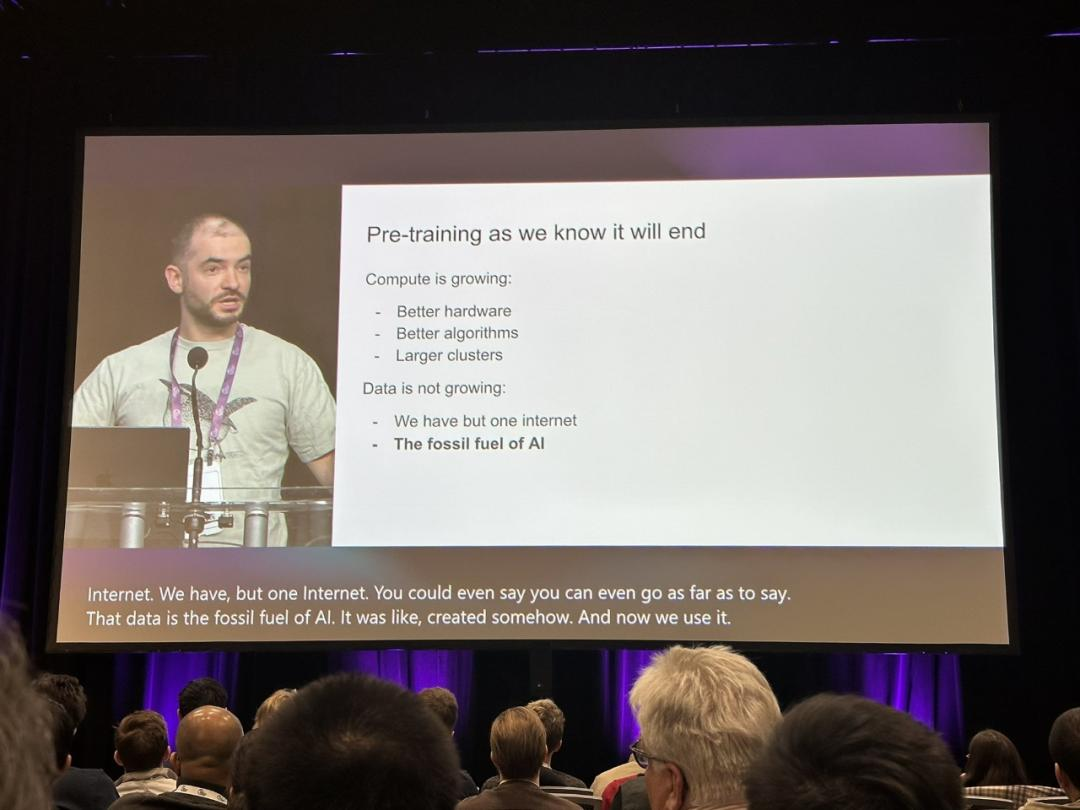

Seiring melonjaknya ukuran parameter model, biaya pelatihan juga meroket. Dengan kehadiran Grok3, pesaing seperti GPT-4.5 dan lainnya yang ingin terus "membakar uang" untuk mencapai kinerja model yang lebih baik melalui ukuran parameter harus mempertimbangkan batasan yang kini terlihat jelas dan merenungkan cara mengatasinya. Saat ini, Ilya Sutskever, mantan kepala ilmuwan di OpenAI, sebelumnya telah menyatakan Desember lalu, "Pelatihan awal yang kita kenal akan berakhir," yang muncul kembali dalam diskusi, mendorong upaya untuk menemukan jalur yang benar untuk melatih model besar.

Pandangan Ilya telah membunyikan alarm di industri. Ia secara akurat meramalkan akan segera habisnya data baru yang dapat diakses, yang mengarah ke situasi di mana kinerja tidak dapat terus ditingkatkan melalui akuisisi data, menyamakannya dengan habisnya bahan bakar fosil. Ia mengindikasikan bahwa "seperti minyak, konten yang dihasilkan manusia di internet adalah sumber daya yang terbatas." Dalam prediksi Sutskever, model generasi berikutnya, pasca-pelatihan awal, akan memiliki "otonomi sejati" dan kemampuan penalaran "yang mirip dengan otak manusia."

Tidak seperti model pra-latihan saat ini yang terutama mengandalkan pencocokan konten (berdasarkan konten model yang dipelajari sebelumnya), sistem AI masa depan akan mampu mempelajari dan membangun metodologi untuk memecahkan masalah dengan cara yang mirip dengan "pemikiran" otak manusia. Manusia dapat mencapai kemahiran mendasar dalam suatu subjek hanya dengan literatur profesional dasar, sementara model AI yang besar memerlukan jutaan titik data untuk mencapai kemanjuran tingkat pemula yang paling dasar. Bahkan ketika kata-katanya diubah sedikit, pertanyaan mendasar ini mungkin tidak dipahami dengan benar, yang menggambarkan bahwa model tersebut belum benar-benar meningkat dalam kecerdasan: pertanyaan dasar namun tidak dapat dipecahkan yang disebutkan di awal artikel merupakan contoh yang jelas dari fenomena ini.

Kesimpulan

Namun, di luar kekuatan kasar, jika Grok3 benar-benar berhasil mengungkapkan kepada industri bahwa "model yang telah dilatih sebelumnya sudah mendekati akhir," hal itu akan membawa implikasi yang signifikan bagi bidang tersebut.

Mungkin setelah kegilaan seputar Grok3 berangsur mereda, kita akan menyaksikan lebih banyak kasus seperti contoh Fei-Fei Li dalam "menyetel model berkinerja tinggi pada kumpulan data tertentu hanya dengan $50," yang pada akhirnya menemukan jalur sejati menuju AGI.

Kabel Kontrol

Sistem Pengkabelan Terstruktur

Jaringan & Data, Kabel Serat Optik, Kabel Patch, Modul, Pelat Depan

16-18 April 2024 Energi Timur Tengah di Dubai

16-18 April 2024 Securika di Moskow

9 Mei 2024 ACARA PELUNCURAN PRODUK & TEKNOLOGI BARU di Shanghai

22-25 Oktober 2024 KEAMANAN CHINA di Beijing

19-20 November 2024 CONNECTED WORLD KSA

Waktu posting: 19-Feb-2025